La stereopsi adattiva

Il forte senso della profondità permesso dalla visione stereoscopica richiede un enorme sforzo di elaborazione da parte del cervello:

prima di poter fare una valutazione "trigonometrica" delle distanze, deve infatti stabilire quali punti delle due diverse immagini retiniche

inviategli dagli occhi sono in corrispondenza fra loro.

Un importante progresso verso la comprensione del meccanismo sottostante alla visione stereoscopica è stato fatto da un gruppo di ricercatori

dell'Università della California a Berkeley, che firmano un articolo su “Science Advances”. Lo studio – finanziato dai National Institutes of

Health, dal National Defense Science & Engineering Graduate Fellowship Program degli Stati Uniti e dalla Swiss National Science Foundation –

può avere importanti ricadute per lo sviluppo di tecnologie 3D virtuali più naturali.

La visione stereoscopica è permessa dal fatto che i due occhi osservano gli oggetti da due punti di vista differenti. Le due immagini

sono inviate al cervello che cerca somiglianze e differenze (o disparità naturali) tra esse per creare un immagine tridimensionale e

percepire la profondità.

La visione stereoscopica è permessa dal fatto che i due occhi osservano gli oggetti da due punti di vista differenti. Le due immagini

sono inviate al cervello che cerca somiglianze e differenze (o disparità naturali) tra esse per creare un immagine tridimensionale e

percepire la profondità.

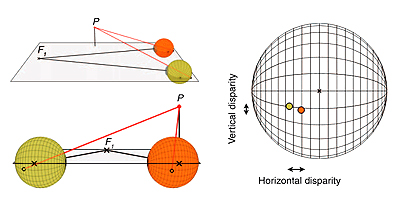

Gli occhi fissano il punto F1, che si trova diritto davanti a sé. Il punto P è posizionato in alto e a destra del volto dell’osservatore,

ed è più vicino di F1. La figura in alto a sinistra mostra una vista laterale e quella in basso a sinistra una vista da dietro gli occhi.

Le linee di uguale azimut ed elevazione, secondo le coordinate Helmholtz, sono disegnate su ogni occhio.

I punti gialli e arancioni corrispondono alla proiezione degli occhi sinistro e destro. La disparità binoculare è rappresentatea dalla

differenza tra le proiezioni degli occhi sinistro e destro. La differenza di azimuth è la disparità orizzontale e la differenza in elevazione

è la disparità verticale.

A prima vista si potrebbe pensare che nella definizione della profondità, ossia delle distanze, il cervello sia impegnato in un semplice

compito di tipo trigonometrico. In realtà, l'elaborazione che deve compiere è molto più complessa, dato che prima di poterlo eseguire deve

risolvere un altro problema computazionalmente ben più impegnativo: quali parti delle due immagini retiniche corrispondono l'una all'altra?

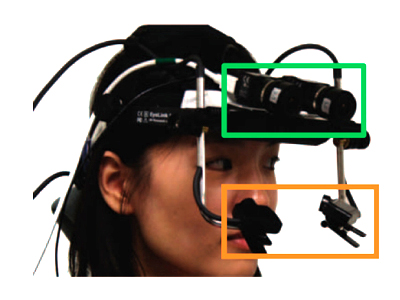

Per ricostruire esattamente quale tipo di differenze vengono catturate da ciascun occhio, Emily Cooper e colleghi hanno progettato un dispositivo

composto da due telecamere stereo (da indossare mettendole sulla fronte, appena sopra agli occhi) abbinate a un sistema di eye-tracking, in modo

che le telecamere fissassero esattamente ciò che fissavano i tre volontari che hanno partecipato allo studio.

L'apparato sperimentale, dotato di telecamere (in verde) e di eye-tracker (in rosso).

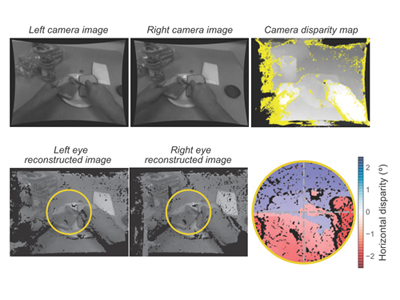

I soggetti dovevano dedicarsi a normali attività quotidiane, come ordinare un caffè al bar, farsi un panino o parlare mentre passeggiavano, sia

in ambienti chiusi che all'aperto. I dati provenienti dalle telecamere sono stati poi usati per ricostruire l'immagine di ciascun occhio e scoprire

quali differenze erano sfruttate dal cervello.

Al centro le immagini riprese dalle telecamere e i loro punti di differenza. In basso, la ricostruzione dell'immagine vista.

Dall'analisi di questi dati – e in particolare da quelli sulla distanza di fissazione dello sguardo nelle diverse circostanze

(valutabili grazie all’eye-tracker) - sembra che per stimare la profondità il cervello parta da un modello globale di ciò che vede,

valutando complessivamente, in modo statistico, la distribuzione di luminanza, il contrasto, e l'orientamento, per poi fissarsi su

un numero ristretto di particolari che usa come punti di riferimento.

Il problema che si apre ora, osservano gli autori, riguarda l'origine di questo complesso procedimento, ossia se nel cervello esistano

reti neurali già perfettamente cablate per compierlo, o se per il suo buon funzionamento intervenga anche un processo di apprendimento.

Riferimenti

Sprague W.W., Cooper E.A., Tošić I., Banks M.S. (2015). Stereopsis is adaptive for the natural en vironment. Science advances, 1(4), e1400254.

Scarica il pdf